Général

Dissuasion Augmentée par l’IA : Entre Promesses et Pièges

L’intelligence artificielle (IA) suscite des craintes depuis longtemps, évoquant des robots tueur à la Terminator. Pourtant, son intégration dans les stratégies militaires, notamment la dissuasion, pourrait révolutionner la sécurité nationale. Imaginez des décideurs ayant accès à des données en temps réel, analysées par l’IA en quelques secondes, permettant d’identifier et de neutraliser les menaces avec une rapidité inégalée. Cependant, cette avancée soulève des défis éthiques et des questions de responsabilité. Il est crucial d’établir des cadres de gouvernance robustes pour garantir une utilisation responsable de l’IA dans ce domaine sensible.

Intelligence Artificielle et Dissuasion : Une Révolution en Cours

Depuis longtemps, le terme Intelligence Artificielle (IA) évoque des images de robots meurtriers à la manière de « Terminator » et de machines prenant le contrôle du monde humain, semblables à « The Matrix ». Ce n’est que dans la dernière décennie que les gouvernements, les entreprises privées et le milieu académique ont commencé à investir massivement et à mener des recherches dans ce domaine pour mieux en comprendre les subtilités. Cependant, le rôle potentiel de l’IA dans des stratégies militaires clés, comme la dissuasion, reste un domaine relativement inexploré.

Une Nouvelle Dimension pour la Sécurité Nationale

Des experts estiment que l’intégration de l’IA et de la dissuasion pourrait engendrer une nouvelle révolution dans le paysage de la sécurité nationale. Imaginez un monde où les décideurs ont accès à des données en temps réel, analysées par l’IA en quelques secondes, permettant d’identifier et de neutraliser les menaces avec une rapidité et une précision sans précédent. Cela pourrait également conduire à un environnement de sécurité où les risques d’escalade accidentelle sont considérablement réduits. Telle est la promesse de l’association de l’IA avec le concept de dissuasion.

Pour naviguer dans ces complexités, il est essentiel que les décideurs soient attentifs à l’utilisation responsable des technologies IA, en particulier à des fins de dissuasion, tout en respectant les normes internationales et humanitaires établies. Cette approche sera cruciale pour maximiser les avantages de l’IA dans le renforcement de la dissuasion tout en atténuant les risques potentiels.

Défis Éthiques et Techniques

Cependant, des défis profonds, y compris des dilemmes éthiques, accompagnent l’essor de l’IA dans ce domaine. À mesure que les États avancent dans leurs recherches technologiques, les décideurs devront non seulement prendre en compte les avantages de cette nouvelle technologie, mais aussi ses conséquences potentielles.

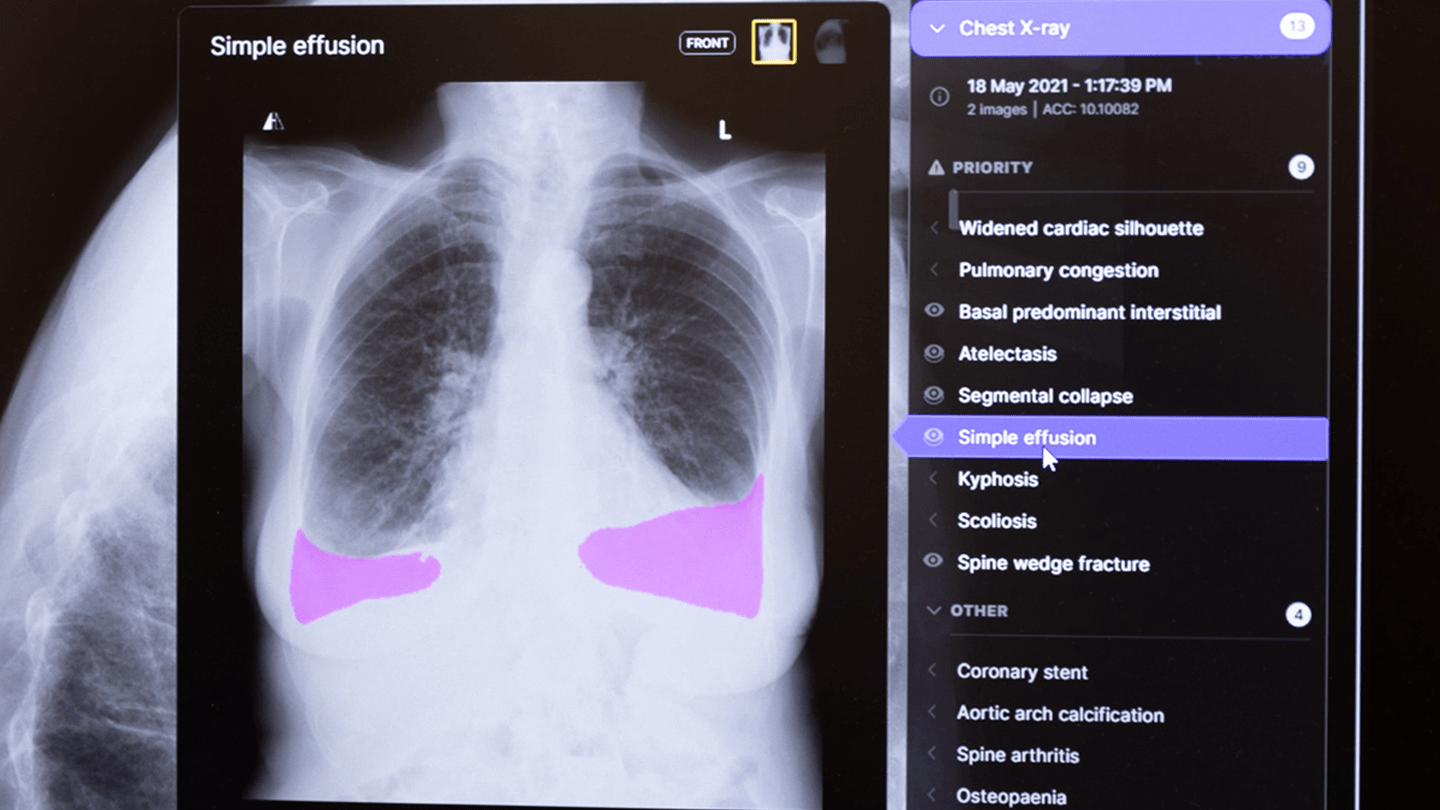

Un des concepts fondamentaux de la dissuasion est que des capacités défensives plus solides conduisent à des options de « dissuasion par déni » plus efficaces, considérées comme le modèle de dissuasion privilégié. Dans ce contexte, l’IA a le potentiel de renforcer la précision, la rapidité et la fiabilité des systèmes d’armement défensifs, dissuadant ainsi les agresseurs potentiels de recourir à des options préventives.

Amélioration des Stratégies Militaires

Au-delà des actions cinétiques, l’IA peut également améliorer la capacité des États à planifier et à exécuter des stratégies tant offensives que défensives. Elle peut optimiser la logistique, la coordination, la formation, la communication et le déploiement, augmentant ainsi considérablement l’efficacité globale des opérations militaires. Comme l’illustre le conflit actuel en Ukraine, les systèmes de gestion basés sur l’IA peuvent rendre les menaces coercitives plus robustes, convaincantes et réalisables.

De plus, l’IA peut renforcer la crédibilité de la dissuasion. En fournissant des renseignements précis et opportuns, les systèmes d’IA peuvent soutenir une prise de décision plus éclairée, consolidant ainsi la posture dissuasive. Cette capacité est particulièrement cruciale dans le contexte de la dissuasion nucléaire, où les enjeux sont extrêmement élevés.

Risques d’Escalade et Manque de Transparence

Malgré ces avantages évidents, l’intégration de l’IA dans les stratégies de dissuasion n’est pas sans défis. Les innovations dans les technologies et méthodologies de guerre entraînent souvent des réactions de la part des adversaires, et la prise de décision améliorée par l’IA ne fera probablement pas exception. Si un camp dans un conflit obtient des avantages significatifs grâce à l’intégration de l’IA, l’autre camp est également susceptible d’adopter des technologies similaires. Cela pourrait conduire à un avenir où des systèmes d’IA concurrents, opérant à la vitesse des machines, n’offrent que de brefs créneaux d’avantage, entraînant une mentalité de « l’utiliser ou le perdre » parmi les adversaires et modifiant les calculs d’escalade traditionnels.

De plus, l’opacité des algorithmes d’IA constitue un autre défi majeur. Actuellement, il existe un manque de transparence sur la manière dont les systèmes d’IA prennent réellement des décisions, ce qui peut engendrer une méfiance entre les États. Même parmi des adversaires ayant des politiques militaires ou nucléaires délibérément ambiguës, il existe une compréhension des seuils et des lignes rouges de chacun. Sans une compréhension claire des processus décisionnels d’un adversaire, en particulier ceux impliquant des systèmes d’IA, le risque de mauvaise interprétation et d’escalade involontaire augmente. Des spécialistes soulignent que la propension de l’IA à l’imprévisibilité pourrait compromettre la stabilité stratégique plutôt que de l’améliorer, surtout si les adversaires perçoivent les décisions prises par l’IA comme irrationnelles ou excessivement agressives.

Vers une Gouvernance Responsable de l’IA

En outre, bien que les systèmes d’IA soient très avancés, ils ne sont pas infaillibles. Ils sont sujets à des biais, des erreurs et des cyberattaques, ce qui pourrait entraîner une escalade involontaire. L’utilisation de l’IA dans les postures de dissuasion soulève également des questions éthiques et juridiques. Déléguer la prise de décision critique à l’IA remet en question non seulement les normes éthiques de la dissuasion, mais aussi les cadres juridiques régissant l’utilisation de la force. Le potentiel de l’IA à initier des actions militaires de manière autonome brouille les lignes de responsabilité, soulevant des préoccupations quant à la conformité avec le droit international humanitaire.

Pour relever ces défis, des approches multifacettes sont nécessaires. Il est crucial d’établir des cadres de gouvernance et de responsabilité robustes pour l’IA au niveau international. Cela inclut la promotion de la transparence dans l’utilisation des algorithmes d’IA à des fins de dissuasion et l’assurance que la supervision humaine demeure un pilier de la prise de décision critique dans le domaine militaire.

En somme, il est impératif que les décideurs soient attentifs à l’utilisation responsable des technologies d’IA, en particulier pour des fins de dissuasion, tout en respectant les normes internationales et humanitaires établies. Cette approche sera essentielle pour maximiser les avantages de l’IA dans le renforcement de la dissuasion tout en atténuant les risques potentiels.

Général

Anker SOLIX dévoile la Solarbank 2 AC : la nouvelle ère du stockage d’énergie ultra-compatible !

Découvrez le Solarbank 2 AC, une véritable révolution dans le domaine de l’énergie solaire ! Grâce à ses batteries au phosphate de fer lithium, ce système s’adapte parfaitement à vos besoins. Avec une puissance impressionnante de 2400 watts et la possibilité d’ajouter jusqu’à cinq batteries supplémentaires, il assure un stockage optimal. Sa compatibilité avec le compteur Anker SOLIX Smart favorise une gestion intelligente de votre consommation énergétique. Ne ratez pas l’offre spéciale « early bird », disponible dès maintenant pour seulement 999 euros ! Saisissez cette chance unique !

Le Solarbank 2 AC : Une Révolution dans le Stockage Énergétique

Batteries au Lithium Fer Phosphate

Le Solarbank 2 AC se démarque par l’utilisation de batteries au lithium fer phosphate (LFP), reconnues pour leur sécurité et leur efficacité. Ce modèle est particulièrement innovant grâce à son système de couplage alternatif, qui lui permet de s’adapter facilement à divers systèmes solaires déjà en place.Que ce soit pour des installations sur toiture, des systèmes solaires compacts pour balcons ou d’autres configurations réduites, il peut fonctionner avec un micro-onduleur de 800 Watts.

Capacité et flexibilité Énergétique

Avec une capacité maximale d’injection dans le réseau domestique atteignant 1200 watts,le Solarbank 2 AC peut être associé à deux régulateurs solaires MPPT. Cela ouvre la possibilité d’ajouter jusqu’à 1200 watts supplémentaires via des panneaux solaires additionnels, portant ainsi la puissance totale à un impressionnant 2400 watts. Pour les utilisateurs nécessitant davantage de stockage énergétique, il est possible d’intégrer jusqu’à cinq batteries supplémentaires de 1,6 kilowattheure chacune, augmentant la capacité totale à 9,6 kilowattheures.

Intégration dans un Écosystème Intelligent

Le Solarbank 2 AC s’intègre parfaitement dans un écosystème énergétique intelligent grâce à sa compatibilité avec le compteur Anker SOLIX Smart et les prises intelligentes proposées par Anker. cette fonctionnalité permet une gestion optimisée de la consommation électrique tout en réduisant les pertes énergétiques inutiles. De plus, Anker SOLIX prévoit d’étendre cette compatibilité aux dispositifs Shelly.

Durabilité et Résistance aux Intempéries

Anker SOLIX met également l’accent sur la longévité du Solarbank 2 AC. Conçu pour supporter au moins 6000 cycles de charge, cet appareil a une durée de vie estimée dépassant quinze ans. Il est accompagné d’une garantie fabricant décennale et possède une certification IP65 qui assure sa résistance face aux intempéries tout en étant capable de fonctionner dans des températures variant entre -20 °C et +55 °C.

Disponibilité et Offres Promotionnelles

Le solarbank 2 AC est disponible sur le site officiel d’Anker SOLIX ainsi que sur Amazon au prix standard de 1299 euros. Cependant, une offre promotionnelle « early bird » sera active du 20 janvier au 23 février 2025, permettant aux acheteurs intéressés d’acquérir cet appareil dès 999 euros ! Cette promotion inclut également un compteur Anker SOLIX Smart offert pour chaque commande passée durant cette période spéciale.

le Solarbank 2 AC représente une avancée significative dans le domaine du stockage énergétique domestique grâce à ses caractéristiques techniques avancées et son engagement envers la durabilité environnementale.

Business

Une formidable nouvelle pour les conducteurs de voitures électriques !

Excellente nouvelle pour les conducteurs de véhicules électriques ! La recharge gratuite sur le lieu de travail sera exonérée d’impôts jusqu’en 2025. Annoncée par le ministère de l’Économie, cette mesure incitative, en place depuis 2020, s’inscrit dans une dynamique de croissance impressionnante avec une progression annuelle moyenne de 35%. Les entreprises peuvent ainsi offrir des bornes de recharge sans impact fiscal, stimulant la transition écologique. Reste à savoir si cela suffira à convaincre les entreprises hésitantes et à propulser l’électrification des flottes professionnelles vers un avenir durable.

Technologie

Recharge Électrique au Bureau : Une Exonération Fiscale Renouvelée

Les détenteurs de véhicules électriques et leurs employeurs peuvent se réjouir : la possibilité d’effectuer des recharges gratuites sur le lieu de travail sera exonérée d’impôts jusqu’en 2025. Cette décision, annoncée par le ministère des Finances, prolonge une initiative lancée en 2020 pour encourager l’adoption des véhicules électriques dans les entreprises.

Un Secteur en Croissance Dynamique

Cette prolongation intervient à un moment clé, alors que le marché des voitures électriques continue d’afficher une croissance remarquable. Entre 2020 et 2022, la progression annuelle moyenne a atteint 35%. En 2023, les particuliers représentent désormais 84% des acquisitions de véhicules électriques, contre seulement 68% en 2018.

Concrètement,cette mesure permet aux sociétés d’installer gratuitement des bornes de recharge pour leurs employés sans impact fiscal. Les frais liés à l’électricité pour ces recharges ne seront pas pris en compte dans le calcul des avantages en nature. De plus, un abattement de 50% sur ces avantages est maintenu avec un plafond révisé à environ 2000 euros pour l’année prochaine.

Accélération Vers une Mobilité Électrique

Cette initiative fait partie d’une stratégie globale visant à promouvoir l’électrification du parc automobile français. Cependant, les grandes entreprises rencontrent encore des difficultés pour atteindre leurs objectifs ; seulement 8% des nouveaux véhicules immatriculés par ces entités étaient électriques en 2023. Ces incitations fiscales pourraient néanmoins inciter davantage d’employeurs à franchir le pas.Cependant, plusieurs défis demeurent concernant les infrastructures nécessaires au chargement ainsi que sur l’autonomie des véhicules et les perceptions parmi les employés. Par ailleurs, la réduction progressive du bonus écologique pour les utilitaires et sa diminution pour les particuliers pourraient freiner cet élan vers une adoption plus large.

Avenir Prometteur Pour La Mobilité Électrique

Malgré ces obstacles potentiels, il existe un optimisme quant au futur de la mobilité électrique dans le milieu professionnel. Les avancées technologiques continues ainsi qu’un engagement croissant envers la durabilité devraient continuer à favoriser cette tendance vers une adoption accrue des véhicules écologiques.

En maintenant ces mesures fiscales avantageuses jusqu’en 2025 et au-delà, le gouvernement délivre un message fort soutenant la transition écologique dans le secteur du transport. Reste maintenant à voir si cela suffira réellement à convaincre certaines entreprises hésitantes et si cela permettra d’accélérer significativement l’électrification de leurs flottes professionnelles dans un avenir proche.

Divertissement

« À la rencontre d’un Hugo : une aventure inattendue »

Le prénom, un véritable reflet de notre identité, peut être à la fois lourd à porter et source de fierté. Dans cette chronique fascinante, le réalisateur Hugo David nous plonge dans son expérience avec un prénom très répandu. Né en 2000, il se retrouve entouré d’autres Hugo, ce qui l’amène à adopter un alias : Hugo D.. Comment ce choix a-t-il influencé son parcours ? Explorez les nuances et les histoires derrière nos prénoms et découvrez comment ils façonnent nos vies dès l’enfance jusqu’à l’âge adulte !

Les Prénoms : Un Voyage au Cœur de l’Identité

Le Rôle Crucial des Prénoms dans nos Existences

Chaque personne possède un prénom, qu’il soit courant ou singulier, et ce dernier peut engendrer à la fois fierté et embarras. Cet article explore la signification profonde et l’influence des prénoms sur notre vie quotidienne. Le réalisateur Hugo David partage son vécu avec un prénom qui a connu une forte popularité durant sa jeunesse.

une Naissance Sous le Signe de la Célébrité

Hugo David est né en 2000 à Tours, une époque où le prénom Hugo était en plein essor. Ses parents, Caroline et Rodolphe, avaient envisagé d’autres choix comme Enzo, également très en vogue à cette période. « Je pense que mes parents ont opté pour un prénom parmi les plus répandus en France plutôt qu’en hommage à Victor Hugo », confie-t-il.

Une Enfance Entourée d’Autres « Hugo »

Dès son plus jeune âge, Hugo se retrouve entouré d’autres enfants portant le même nom. Selon les statistiques de l’Insee,7 694 garçons ont été prénommés Hugo en 2000,faisant de ce prénom le quatrième plus populaire cette année-là. À l’école primaire,il côtoie plusieurs camarades appelés Thibault et autres prénoms similaires. Pour éviter toute confusion lors des appels en classe, les enseignants ajoutent souvent la première lettre du nom de famille après le prénom : ainsi devient-il rapidement « Hugo D. », un surnom auquel il s’habitue sans arduousé.

Pensées sur l’Identité Associée au Prénom

Le choix d’un prénom peut avoir un impact significatif sur notre identité personnelle tout au long de notre existence. Que ce soit pour se distinguer ou pour s’intégrer dans un groupe social spécifique, chaque individu développe une relation particulière avec son propre nom.

les prénoms ne sont pas simplement des désignations ; ils portent avec eux des récits et influencent nos interactions sociales depuis notre enfance jusqu’à l’âge adulte.

-

Business2 ans ago

Business2 ans agoComment lutter efficacement contre le financement du terrorisme au Nigeria : le point de vue du directeur de la NFIU

-

Général2 ans ago

Général2 ans agoX (anciennement Twitter) permet enfin de trier les réponses sur iPhone !

-

Technologie1 an ago

Technologie1 an agoTikTok revient en force aux États-Unis, mais pas sur l’App Store !

-

Général1 an ago

Général1 an agoAnker SOLIX dévoile la Solarbank 2 AC : la nouvelle ère du stockage d’énergie ultra-compatible !

-

Général1 an ago

Général1 an agoLa Gazelle de Val (405) : La Star Incontournable du Quinté d’Aujourd’hui !

-

Sport1 an ago

Sport1 an agoSaisissez les opportunités en or ce lundi 20 janvier 2025 !

-

Business1 an ago

Business1 an agoUne formidable nouvelle pour les conducteurs de voitures électriques !

-

Science et nature1 an ago

Science et nature1 an agoDes Projets Ambitieux qui Pourraient Redéfinir la Géopolitique