Les Yeux : Une Fenêtre sur l’Illusion

Le dicton dit que les yeux sont le reflet de l’âme, mais dans le contexte des images deepfake, ils pourraient plutôt révéler une réalité altérée.

Une Étude Innovante de l’Université de Hull

Une recherche récente menée à l’Université de Hull, au Royaume-Uni, a utilisé des techniques habituellement réservées à l’observation des galaxies lointaines pour évaluer l’authenticité des visages humains dans les images. Kevin Pimbblet, professeur d’astrophysique, a été inspiré par ses études sur les images générées par intelligence artificielle (IA) via des générateurs d’art comme Midjourney et Stable Diffusion. Il s’est demandé s’il pouvait appliquer des principes physiques pour distinguer les images réelles des fausses. « Les réflexions dans les yeux semblaient être un indicateur évident à analyser, » a-t-il déclaré à Space.com.

Comprendre les Deepfakes

Les deepfakes sont des images ou vidéos falsifiées de personnes, créées par des algorithmes d’IA formés sur d’énormes ensembles de données. Lors de la création d’un visage humain, l’IA assemble un visage fictif pixel par pixel, soit en partant de zéro, soit en se basant sur des personnes réelles. Dans ce dernier cas, ces images sont souvent utilisées à des fins malveillantes. Bien que les photos authentiques contiennent des réflexions, l’IA les intègre également, mais des différences subtiles peuvent apparaître entre les deux yeux.

Développement d’un Outil d’Analyse

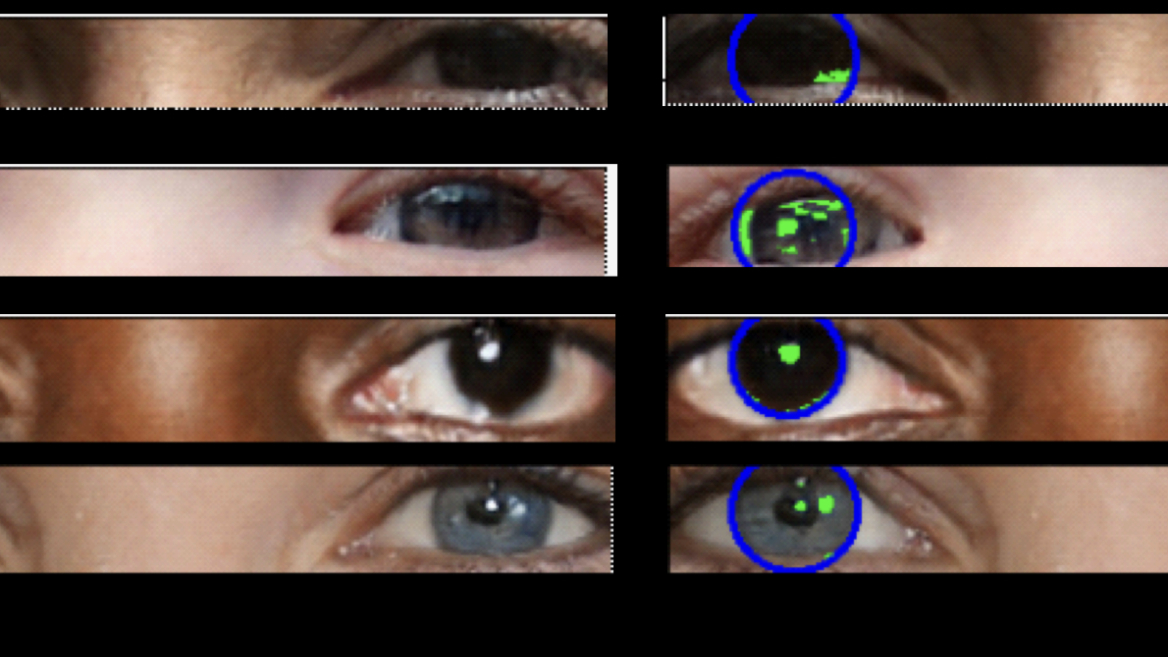

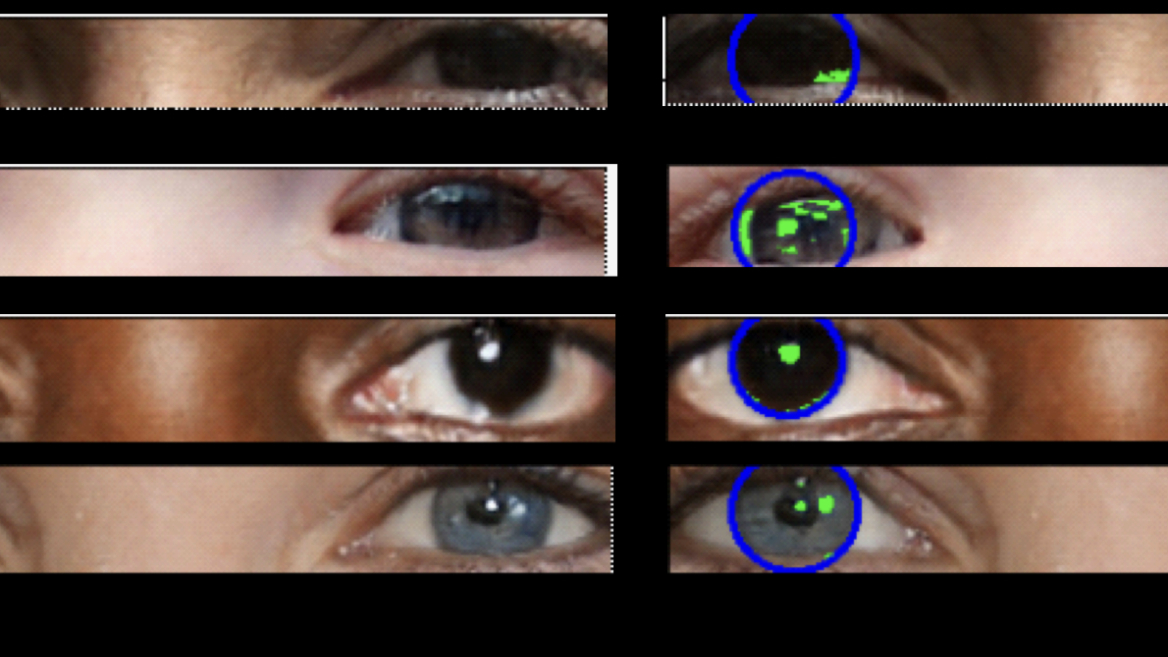

Pimbblet a collaboré avec Adejumoke Owolabi, une étudiante en Master, pour concevoir un logiciel capable d’analyser rapidement les yeux des sujets dans diverses images afin de vérifier la cohérence des réflexions. Ensemble, ils ont créé un programme pour évaluer les différences entre les yeux gauche et droit dans des photos de visages, qu’ils soient réels ou générés par IA. Les visages réels provenaient d’un ensemble de données varié de 70 000 visages sur Flickr, tandis que les deepfakes étaient issus du site This Person Does Not Exist, qui génère des images réalistes de personnes fictives.

Analyse des Réflexions

Après avoir rafraîchi le site This Person Does Not Exist plusieurs fois, Pimbblet a examiné les réflexions dans les yeux. Bien que les visages soient impressionnants et ne laissent pas immédiatement transparaître leur nature artificielle, une inspection plus minutieuse a révélé des différences presque imperceptibles dans l’éclairage des yeux. Dans un cas, l’IA avait généré un homme portant des lunettes, et la réflexion dans ses verres semblait également décalée.

Techniques Astronomiques Appliquées

Pour quantifier ces différences, Pimbblet et Owolabi ont utilisé des techniques issues de l’astronomie, notamment les « paramètres CAS » et « l’indice de Gini ». Les paramètres CAS permettent d’analyser la structure d’une galaxie en examinant la concentration, l’asymétrie et la douceur d’un profil lumineux. Cependant, ils ont constaté que ces paramètres n’étaient pas aussi efficaces pour détecter les deepfakes, car les réflexions apparaissent souvent comme des taches de lumière dispersées sur l’œil.

Utilisation de l’Indice de Gini

L’indice de Gini, qui mesure l’inégalité à travers une gamme de valeurs, s’est avéré plus efficace. Il permet d’évaluer la distribution des pixels entre les yeux gauche et droit, offrant une approche robuste pour cette analyse. « L’indice de Gini examine la distribution globale des pixels et peut déterminer si les valeurs des pixels sont uniformément réparties, » a expliqué Pimbblet.

Perspectives Futures et Défis

Bien que cette recherche ait été présentée lors d’une réunion de la Royal Astronomical Society, elle n’a pas encore été soumise à une évaluation par les pairs. Pimbblet souligne que le logiciel est encore à un stade expérimental, avec un taux d’erreur d’environ 30 %. De plus, il n’a été testé que sur un seul modèle d’IA jusqu’à présent. « Nous n’avons pas encore testé d’autres modèles, mais cela sera une étape évidente à suivre, » a-t-il ajouté.

Implications pour la Détection des Deepfakes

Dan Miller, psychologue à l’Université James Cook en Australie, a noté que les résultats de cette étude sont intéressants, mais pourraient ne pas être immédiatement utiles pour améliorer la détection humaine des deepfakes, car la méthode nécessite une modélisation mathématique complexe de la lumière. Cependant, il a souligné que ces découvertes pourraient contribuer au développement de logiciels de détection de deepfakes.

La Nécessité d’un Logiciel de Détection

Avec la sophistication croissante des deepfakes, un logiciel de détection semble de plus en plus nécessaire. Une étude de 2023 a révélé que les participants avaient du mal à identifier les vidéos deepfake, même lorsqu’on leur fournissait des indices visuels. Les résultats ont montré que ces conseils n’amélioraient pas la capacité des sujets à détecter les faux visages.

Questions Éthiques et Futur de l’IA

Cette recherche soulève des questions fascinantes : si l’IA peut générer des réflexions analysables par des méthodes astronomiques, pourrait-elle également créer des galaxies entières ? Pimbblet mentionne des études antérieures qui ont exploré cette possibilité, notamment une recherche de 2017 sur les réseaux antagonistes génératifs (GANs) capables de reconstruire des galaxies à partir de données dégradées.

Alors que des volumes massifs de données continuent d’affluer des missions d’observation de l’univers, l’IA pourrait devenir essentielle pour analyser ces informations. La génération de galaxies par IA pourrait également former des modèles pour identifier des galaxies réelles dans d’énormes ensembles de données. Bien que cela puisse sembler dystopique, la détection de visages artificiels avec des variations subtiles dans les réflexions des yeux l’est tout autant.