Technologie

La désinformation : un fléau qui va au-delà des réseaux sociaux

La désinformation sur les réseaux sociaux a pris une ampleur alarmante, exacerbée par des événements tragiques comme le meurtre d’enfants à Southport. Les fausses informations ont rapidement circulé, alimentant la violence et la haine. Selon le psychologue Stephan Lewandowsky, la psychologie humaine joue un rôle clé dans l’adhésion à ces théories. Les réseaux sociaux, en amplifiant ces récits, créent un consensus illusoire qui incite à l’action. Alors que la société se débat avec ces questions, il est crucial de comprendre les racines profondes de ce phénomène. La responsabilité collective est plus que jamais d’actualité.

Technologie : Les racines profondes de la désinformation

Le 29 juillet 2024, un événement tragique a marqué les esprits au Royaume-Uni : Axel Rudakubana a tué trois enfants lors d’un cours de danse de Taylor Swift dans la ville de Southport, dans le Merseyside. Tous les trois étaient âgés de moins de 10 ans.

Peu après, des comptes de fausse information et des figures d’extrême droite sur les réseaux sociaux ont commencé à diffuser des mensonges concernant l’attaque, affirmant notamment que l’auteur était Ali Al-Shakati, un migrant musulman récemment arrivé dans le pays. Le lendemain de l’attaque, ce nom erroné avait été mentionné plus de 30 000 fois sur X, et l’algorithme de la plateforme l’avait même recommandé aux utilisateurs comme un sujet tendance.

Des organisateurs et groupes d’extrême droite ont profité de la viralité de ces histoires pour organiser une marche à Southport, qui a rapidement dégénéré en violence. Les participants ont lancé des briques et des bouteilles sur une mosquée locale, incendié des voitures et des fourgons de police déployés pour protéger le bâtiment. La violence s’est ensuite propagée à d’autres mosquées et hôtels abritant des demandeurs d’asile à travers le pays. Lorsque ces cibles n’étaient pas accessibles, les émeutiers ont incendié des bibliothèques, des bureaux d’aide aux citoyens ou des voitures de travailleurs sociaux. Avant que la violence ne s’apaise, des avocats spécialisés en immigration ont commencé à fuir les villes après avoir reçu des menaces de mort de la part de l’extrême droite.

Les semaines suivantes ont vu un examen approfondi du rôle des réseaux sociaux dans cette tragédie. En effet, c’est la désinformation diffusée sur des plateformes comme X qui a initialement alimenté les allégations infondées selon lesquelles les attaques avaient été perpétrées par un migrant étranger. En réponse à ces événements, le gouvernement a renforcé les sanctions, imposant des peines de prison à ceux qui incitaient à la haine raciale et à la violence, ainsi qu’à ceux qui diffusaient des informations dangereuses en ligne.

Cependant, dans le débat public sur les dangers de la désinformation, peu d’attention a été accordée à la manière dont ce problème s’est développé, et si certaines causes profondes sont plus ancrées qu’on ne le pense.

La psychologie de la désinformation

« Il est évident que la désinformation a joué un rôle crucial », déclare Stephan Lewandowsky, psychologue à l’Université de Bristol spécialisé dans ce domaine. « Dans ce cas précis, le lien entre les informations fausses diffusées sur les réseaux sociaux et les actions des émeutiers par la suite était si unique et précis qu’il est difficile de le nier. »

Cependant, cette causalité directe est rare dans notre écosystème d’information complexe, où il est souvent difficile d’identifier des déclencheurs individuels d’événements.

La situation est plus complexe que la simple invention de la désinformation par les réseaux sociaux. « Depuis le début de l’histoire, beaucoup de communication se fait par la fiction. Nous racontons des histoires pour exprimer des idées », explique Walter Scheirer, auteur d’un ouvrage sur l’histoire des fausses informations sur Internet.

Scheirer soutient que la communication humaine est davantage axée sur l’expression d’idées ou de croyances que sur un récit factuel des événements. La différence majeure aujourd’hui est que les réseaux sociaux ont élargi l’audience et accordent une crédibilité égale à toutes les voix, permettant ainsi de donner « un immense mégaphone à quiconque ».

Des besoins psychologiques profonds poussent les gens vers les théories du complot, selon Karen Douglas, experte en psychologie des théories du complot à l’Université de Kent. Les récits, comme ceux entourant les meurtres de Southport, aident les individus à satisfaire à la fois leurs besoins épistémiques – le désir de « clarté et de certitude » – et leurs besoins existentiels – le besoin de « se sentir en sécurité et d’avoir un certain contrôle » sur les événements. Cela rend souvent ces croyances difficiles à déloger.

« Les gens cherchent des moyens de comprendre ce qui se passe et n’aiment pas l’incertitude qui entoure souvent les événements en cours. De plus, une explication simple n’est souvent pas très attrayante. Les gens supposent qu’il doit y avoir une explication plus vaste ou plus complexe », explique-t-elle. « Une fois que les théories du complot sont lancées, il est difficile de les apaiser, surtout lorsque certains faits restent inconnus. Même après cela, une fois que les gens croient à une théorie du complot, il est souvent difficile de les convaincre du contraire. »

Tendances d’accélération

Les réseaux sociaux sont particulièrement bien placés pour accélérer ce type de récits. Lewandowsky explique que ces plateformes créent un effet de « faux consensus » pour les utilisateurs – en reliant des personnes partageant les mêmes idées à travers de grandes distances, elles donnent l’impression qu’un plus grand nombre de personnes partagent leurs opinions que si elles étaient limitées à des interactions physiques. « Nous savons que les gens agissent davantage en fonction de leurs croyances lorsqu’ils sentent que d’autres les partagent », ajoute-t-il.

Ce phénomène peut expliquer pourquoi un néo-nazi en Finlande a été identifié comme l’un des principaux instigateurs de la violence en tant qu’organisateur sur le chat Southport Wake Up sur l’application de messagerie Telegram, où une grande partie des actions d’extrême droite a été planifiée.

« De plus, le modèle économique de ces plateformes repose sur la création d’engagement, car c’est ainsi qu’elles génèrent des revenus. Si nous restons sur la plateforme en interagissant avec le contenu, elles peuvent nous montrer des publicités et gagner de l’argent grâce à celles-ci », ajoute Lewandowsky. « Les êtres humains prêtent attention à des contenus qui suscitent l’indignation et la colère, des émotions négatives. Pour les plateformes, c’est idéal car elles peuvent vendre des publicités… mais ce n’est pas bénéfique pour une société démocratique. »

Les réseaux sociaux ont atteint une taille qui n’était pas prévue lors des débuts d’Internet. Dans le cadre de ses recherches, Scheirer a découvert que même dans les premiers jours du réseautage informatique, il existait des serveurs « sur les OVNI et les conspirations gouvernementales ». Alors que ces communautés étaient par nature auto-contenues, le paysage ouvert des réseaux sociaux signifie qu’un message diffusé « s’amplifie et s’amplifie » jusqu’à atteindre un public mondial massif. Le discours tend alors à se centraliser de plus en plus autour de ces messages ou idées individuelles.

« Une grande partie de mes recherches vise à imaginer un Internet moins hostile. Je pense que la solution réside vraiment dans le fait de se détourner de ces services de médias sociaux mondiaux qui ne servent pas vraiment à grand-chose », dit-il. « Internet n’a jamais été conçu pour être une base de données de faits. L’idée d’un super autoroute de l’information des années 1990 a été formulée par de grandes entreprises technologiques longtemps après la création d’Internet. »

Des politiques spécifiques mises en place par les plateformes elles-mêmes ont également pu faciliter cette tragédie.

« Il ne fait aucun doute que les réseaux sociaux jouent un rôle très important », déclare Joe Mulhall, directeur de la recherche chez Hope Not Hate. Il cite la réintégration d’Andrew Tate et de Tommy Robinson sur X, où ils ont développé d’énormes suivis et ont contribué à diffuser de la désinformation sur les attaques de Southport.

« La portée de Tommy Robinson a augmenté depuis la réactivation de son compte X l’année dernière », explique Mulhall. « Ses deux dernières manifestations à Londres ont attiré des dizaines de milliers de personnes et son nombre d’abonnés sur X dépasse désormais 800 000, ce qui lui confère à nouveau une portée considérable en ligne. »

Cette influence témoigne du fait que l’extrême droite moderne n’est pas la même que celle que la Grande-Bretagne a connue, même récemment dans les années 2000.

Ce que l’on appelle souvent la « droite post-organisation » est beaucoup plus décentralisée et difficile à définir idéologiquement que l’extrême droite d’autrefois, qui était centrée sur des partis politiques ou des groupes individuels. Aujourd’hui, elle est beaucoup plus disparate, définie par des ensembles individualisés et fluides de peurs, de colères et d’idéologies, façonnés par des figures d’extrême droite spécifiques, comme Tommy Robinson ou Andrew Tate, plutôt que par des groupes ou des partis politiques avec des agendas fixes. Même l’extrême droite semble être influencée par des influenceurs des réseaux sociaux.

Le contexte politique est crucial

Cependant, plusieurs personnes interrogées par Computer Weekly ont souligné que, bien que les réseaux sociaux aient joué un rôle clé dans l’embrasement de la situation, le combustible qui a permis à cette étincelle de se transformer en explosion provenait d’ailleurs.

Des recherches antérieures du Centre de surveillance des médias ont révélé que près de 60 % des articles de la presse britannique sur l’islam étaient négatifs ou véhiculaient des stéréotypes infondés sur les musulmans, certains journaux, comme The Mail on Sunday, étant les pires coupables.

Des études académiques ont même montré que la couverture médiatique peut directement soutenir des partis populistes de droite comme le UKIP, tandis que des experts du Centre d’études sur la haine de l’Université de Leicester ont affirmé que les politiciens et les médias peuvent alimenter les crimes de haine au Royaume-Uni.

« Ce qui me frustre dans la couverture médiatique à ce sujet, c’est que tout le monde est très heureux de parler des réseaux sociaux, mais personne ne reconnaît le contexte politique dans lequel cela se déroule depuis 15 ans au Royaume-Uni », déclare Lewandowsky. « Si l’on examine le bilan des médias tabloïds et du gouvernement précédent ainsi que le langage qu’ils utilisent, ces événements des dernières semaines deviennent beaucoup moins surprenants, car le contexte a été créé pour eux. »

À la suite de ce qui semble être des émeutes ayant changé la société, il reste à voir si des questions beaucoup plus difficiles sur la responsabilité seront posées.

Général

Anker SOLIX dévoile la Solarbank 2 AC : la nouvelle ère du stockage d’énergie ultra-compatible !

Découvrez le Solarbank 2 AC, une véritable révolution dans le domaine de l’énergie solaire ! Grâce à ses batteries au phosphate de fer lithium, ce système s’adapte parfaitement à vos besoins. Avec une puissance impressionnante de 2400 watts et la possibilité d’ajouter jusqu’à cinq batteries supplémentaires, il assure un stockage optimal. Sa compatibilité avec le compteur Anker SOLIX Smart favorise une gestion intelligente de votre consommation énergétique. Ne ratez pas l’offre spéciale « early bird », disponible dès maintenant pour seulement 999 euros ! Saisissez cette chance unique !

Le Solarbank 2 AC : Une Révolution dans le Stockage Énergétique

Batteries au Lithium Fer Phosphate

Le Solarbank 2 AC se démarque par l’utilisation de batteries au lithium fer phosphate (LFP), reconnues pour leur sécurité et leur efficacité. Ce modèle est particulièrement innovant grâce à son système de couplage alternatif, qui lui permet de s’adapter facilement à divers systèmes solaires déjà en place.Que ce soit pour des installations sur toiture, des systèmes solaires compacts pour balcons ou d’autres configurations réduites, il peut fonctionner avec un micro-onduleur de 800 Watts.

Capacité et flexibilité Énergétique

Avec une capacité maximale d’injection dans le réseau domestique atteignant 1200 watts,le Solarbank 2 AC peut être associé à deux régulateurs solaires MPPT. Cela ouvre la possibilité d’ajouter jusqu’à 1200 watts supplémentaires via des panneaux solaires additionnels, portant ainsi la puissance totale à un impressionnant 2400 watts. Pour les utilisateurs nécessitant davantage de stockage énergétique, il est possible d’intégrer jusqu’à cinq batteries supplémentaires de 1,6 kilowattheure chacune, augmentant la capacité totale à 9,6 kilowattheures.

Intégration dans un Écosystème Intelligent

Le Solarbank 2 AC s’intègre parfaitement dans un écosystème énergétique intelligent grâce à sa compatibilité avec le compteur Anker SOLIX Smart et les prises intelligentes proposées par Anker. cette fonctionnalité permet une gestion optimisée de la consommation électrique tout en réduisant les pertes énergétiques inutiles. De plus, Anker SOLIX prévoit d’étendre cette compatibilité aux dispositifs Shelly.

Durabilité et Résistance aux Intempéries

Anker SOLIX met également l’accent sur la longévité du Solarbank 2 AC. Conçu pour supporter au moins 6000 cycles de charge, cet appareil a une durée de vie estimée dépassant quinze ans. Il est accompagné d’une garantie fabricant décennale et possède une certification IP65 qui assure sa résistance face aux intempéries tout en étant capable de fonctionner dans des températures variant entre -20 °C et +55 °C.

Disponibilité et Offres Promotionnelles

Le solarbank 2 AC est disponible sur le site officiel d’Anker SOLIX ainsi que sur Amazon au prix standard de 1299 euros. Cependant, une offre promotionnelle « early bird » sera active du 20 janvier au 23 février 2025, permettant aux acheteurs intéressés d’acquérir cet appareil dès 999 euros ! Cette promotion inclut également un compteur Anker SOLIX Smart offert pour chaque commande passée durant cette période spéciale.

le Solarbank 2 AC représente une avancée significative dans le domaine du stockage énergétique domestique grâce à ses caractéristiques techniques avancées et son engagement envers la durabilité environnementale.

Technologie

Ne manquez pas cette offre incroyable : le Air Fryer Moulinex Easy Fry Max à -42% sur Amazon !

Les soldes d’hiver sont là ! Ne ratez pas l’incroyable offre d’Amazon sur le Moulinex Easy Fry Max, à seulement 69 euros au lieu de 119 euros, soit une réduction sensationnelle de -42% ! Avec sa capacité généreuse de 5 L, cette friteuse sans huile est idéale pour régaler jusqu’à 6 convives. Grâce à ses 10 programmes de cuisson et son interface tactile intuitive, préparez des plats sains et savoureux en un clin d’œil. Dépêchez-vous, les stocks s’épuisent vite et cette offre est limitée dans le temps !

Technologie

Les soldes d’hiver sont en cours, et Amazon en profite pour offrir des promotions intéressantes, notamment sur les friteuses à air. Actuellement, le Moulinex Easy Fry Max est proposé à un prix attractif de 69 euros au lieu de 119 euros, ce qui représente une réduction immédiate de 42 %. C’est une occasion parfaite pour acquérir une friteuse sans huile XL d’une capacité généreuse de 5 L, idéale pour préparer des repas pour jusqu’à six personnes à un tarif très compétitif.

Étant donné que cette offre est limitée dans le temps,il est conseillé d’agir rapidement si vous souhaitez en bénéficier. De plus, avec un tel prix, les stocks pourraient s’épuiser rapidement. Ce modèle se classe parmi les meilleures ventes sur Amazon avec plus de 1000 unités écoulées le mois dernier.

Profitez des offres sur Amazon

Amazon propose également la livraison gratuite et rapide pour cet article qui bénéficie d’une garantie de deux ans. En outre, il existe une option de paiement échelonné en quatre fois sans frais sur ce modèle. Enfin, sachez que vous avez la possibilité de changer d’avis et retourner le produit gratuitement dans un délai de 30 jours afin d’obtenir un remboursement intégral.

Moulinex Easy Fry Max : cuisinez sainement pour toute la famille

Le moulinex Easy Fry Max fonctionne comme un four à air chaud permettant la préparation de plats savoureux tout en utilisant peu ou pas du tout d’huile. En plus des frites croustillantes qu’il réalise parfaitement, cet appareil se révèle très polyvalent et peut cuisiner une multitude d’autres recettes.

avec ses dix programmes prédéfinis adaptés à divers ingrédients tels que poulet,steak,poisson ou légumes ainsi que des options pour bacon et desserts comme les pizzas ,cet appareil répond aux besoins variés des familles modernes. De plus, Moulinex met à disposition un livre numérique rempli de recettes accessible via QR Code afin que vous puissiez facilement trouver l’inspiration culinaire lorsque nécessaire.

Sa capacité généreuse permet non seulement la préparation rapide mais aussi économique : jusqu’à 70 % moins énergivore et presque deux fois plus rapide qu’un four traditionnel ! Son interface intuitive avec écran tactile facilite son utilisation quotidienne.

en outre, le panier antiadhésif compatible lave-vaisselle simplifie grandement l’entretien après chaque utilisation. N’oubliez pas qu’il s’agit là encore d’une offre temporaire ; ne tardez donc pas si vous souhaitez profiter du meilleur prix possible sur cette friteuse innovante !

Pour accéder à cette remise exceptionnelle :

Technologie

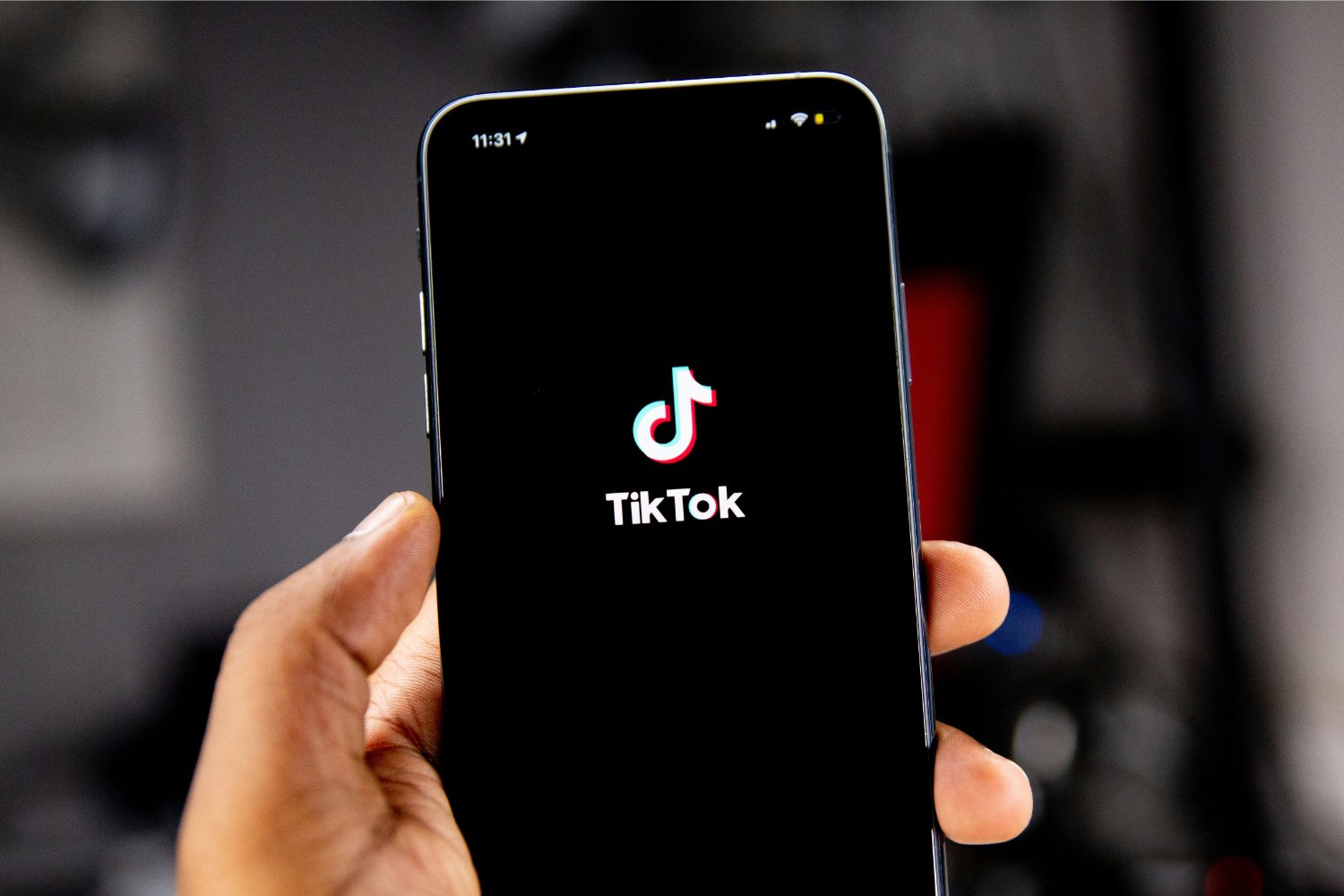

TikTok revient en force aux États-Unis, mais pas sur l’App Store !

Le suspense autour de TikTok est à son comble ! En avril 2024, le Congrès américain a voté une loi obligeant l’application à changer de propriétaire avant le 19 janvier. Les utilisateurs ont anxieusement attendu la décision finale. Bien que TikTok ait brièvement cessé ses activités, elle est revenue en ligne, mais absente de l’App Store. Apple justifie cette décision par des obligations légales. Cependant, les utilisateurs peuvent toujours accéder à leur compte… sans mises à jour. L’avenir de TikTok pourrait prendre un tournant décisif avec les promesses du nouveau président.

Technologie

En avril 2024, le Congrès américain a adopté une législation obligeant TikTok à trouver un nouvel acquéreur, ByteDance étant accusé d’activités d’espionnage. Les utilisateurs de l’submission aux États-Unis ont donc attendu avec impatience le week-end précédent la date limite du 19 janvier pour savoir si TikTok serait interdit dans le pays.

Bien que TikTok n’ait pas réussi à dénicher un repreneur avant cette échéance, l’application a temporairement suspendu ses activités… mais seulement pour quelques heures. le réseau social est désormais de retour en ligne, mais il n’est plus accessible sur l’App Store.

Retour de TikTok : Une Absence Persistante sur l’App Store

Apple a expliqué sa décision de retirer TikTok de son App store par un communiqué officiel. « Apple doit respecter les lois en vigueur dans les régions où elle opère. Selon la loi Protecting Americans from Foreign Adversary Controlled Applications act, les applications développées par ByteDance ltd., y compris TikTok et ses filiales comme CapCut et Lemon8, ne pourront plus être téléchargées ou mises à jour sur l’App Store pour les utilisateurs américains après le 19 janvier 2025 », précise la société.

Il est crucial de souligner que les utilisateurs américains ayant déjà installé TikTok peuvent toujours accéder au service. Cependant, ils ne recevront plus aucune mise à jour future de l’application. L’avenir du réseau social pourrait dépendre des décisions du nouveau président des États-Unis.

DÉCLARATION DE TIKTOK :

>

En collaboration avec nos partenaires techniques, nous travaillons activement à rétablir notre service. Nous remercions le président Trump pour avoir clarifié la situation et rassuré nos partenaires qu’ils ne subiront aucune sanction en continuant d’offrir TikTok aux plus de 170 millions d’utilisateurs…

Le successeur de Joe Biden sera investi comme président ce lundi 20 janvier et prévoit d’émettre un décret afin d’accorder un délai supplémentaire à TikTok pour trouver un acquéreur potentiel.Donald Trump propose même que les États-Unis détiennent une participation significative dans cette application.

« Je souhaite que les États-Unis possèdent une part importante dans une coentreprise avec cet outil numérique afin que nous puissions préserver son intégrité tout en lui permettant d’évoluer […]. Ainsi,notre pays détiendrait la moitié des parts dans une coentreprise établie entre nous et tout acheteur sélectionné »,a déclaré Donald Trump.

L’avenir immédiat de TikTok pourrait donc connaître des évolutions majeures très prochainement. Il convient également de noter qu’une rumeur circulait selon laquelle Elon Musk envisagerait d’acquérir des parts dans la plateforme,mais celle-ci a été rapidement démentie par un porte-parole officiel.

-

Business2 ans ago

Business2 ans agoComment lutter efficacement contre le financement du terrorisme au Nigeria : le point de vue du directeur de la NFIU

-

Général2 ans ago

Général2 ans agoX (anciennement Twitter) permet enfin de trier les réponses sur iPhone !

-

Technologie1 an ago

Technologie1 an agoTikTok revient en force aux États-Unis, mais pas sur l’App Store !

-

Général1 an ago

Général1 an agoAnker SOLIX dévoile la Solarbank 2 AC : la nouvelle ère du stockage d’énergie ultra-compatible !

-

Général1 an ago

Général1 an agoLa Gazelle de Val (405) : La Star Incontournable du Quinté d’Aujourd’hui !

-

Sport1 an ago

Sport1 an agoSaisissez les opportunités en or ce lundi 20 janvier 2025 !

-

Business1 an ago

Business1 an agoUne formidable nouvelle pour les conducteurs de voitures électriques !

-

Science et nature1 an ago

Science et nature1 an agoLes meilleures offres du MacBook Pro ce mois-ci !