Dans un monde où chaque transaction, interaction et communication génère un point de données, il est juste de dire que de nombreuses entreprises créent et gèrent plus de données qu’elles ne savent comment en tirer parti. Les données clients sont souvent conservées dans une base de données ou un autre emplacement éloigné, dans l’espoir qu’elles seront un jour utiles. Cependant, cette vision unifiée du client reste souvent un espoir plutôt qu’une réalité tangible.

Parallèlement, chaque marque s’efforce de trouver des moyens d’offrir des interactions personnalisées et significatives avec chaque client. Il existe ici une perception quelque peu décalée : 81 % des marques affirment comprendre profondément leurs clients, mais seulement 46 % des consommateurs partagent cet avis, selon le rapport 2024 sur l’état de l’engagement client de Twilio. Lier ces deux aspects est essentiel pour une stratégie de données efficace, et c’est là que l’intégration de l’intelligence artificielle (IA) dans cette stratégie devient particulièrement pertinente. L’IA peut automatiser les processus de collecte, d’intégration et d’analyse des données, établissant ainsi des flux de travail qui ouvrent la voie à des expériences client plus significatives.

Simplification des tâches administratives

Le premier cas d’utilisation de l’IA pour soutenir les stratégies de données réside dans la collecte plus efficace des données clients. En association avec une plateforme de données clients (CDP), qui offre une vue unifiée du client avec des données propres, consenties et cohérentes, l’IA peut agir comme un organisateur professionnel des données clients. Elle peut classer les points de données, identifier des corrélations et les stocker de manière facilement récupérable et exploitable. De plus, l’IA peut suggérer comment ces données pourraient être mises à profit, par exemple, en déterminant quels types de personnalisation seraient les plus efficaces pour un groupe de clients donné.

Une fois les données collectées et organisées, il est temps de les exploiter, et là encore, l’IA peut intervenir. En analysant d’énormes ensembles de données, les équipes de données peuvent utiliser l’IA pour adapter leurs stratégies et réaliser des tests et comparaisons éclairés. La segmentation des audiences, le déclenchement de campagnes personnalisées et l’optimisation des messages et des horaires de livraison – l’IA peut faciliter tout cela à grande échelle, permettant aux équipes de se concentrer sur la stratégie globale plutôt que de consacrer du temps à des processus répétitifs.

Profils unifiés

Un troisième cas d’utilisation de l’IA dans le domaine de l’engagement client est la création de profils idéaux – un état où une entreprise dispose d’une représentation complète, précise et dynamique d’un client, mise à jour en continu à mesure que de nouvelles données et insights sont capturés. 64 % des entreprises interrogées dans le rapport 2024 sur l’état de l’engagement client de Twilio ont déclaré utiliser déjà l’IA pour construire une vue unifiée de chaque client, ce qui est prometteur mais montre également le chemin qu’il reste à parcourir. Cet état peut véritablement transformer la manière dont les entreprises optimisent leurs communications marketing. L’IA peut aider à intégrer des données provenant de sources traditionnellement isolées en un seul profil cohérent, tout en nettoyant et corrigeant les incohérences au passage.

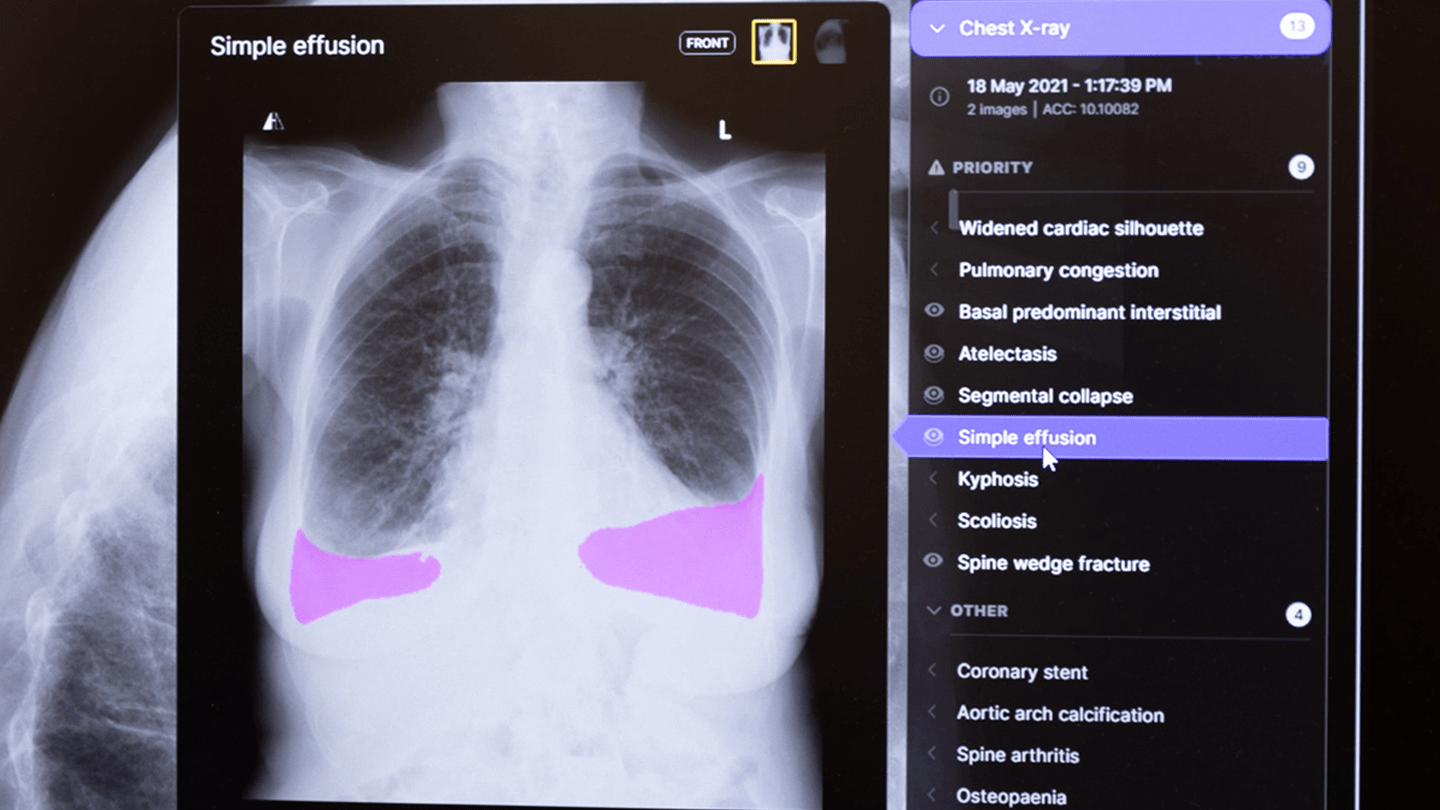

À mesure que les organisations se familiarisent avec l’utilisation de l’IA dans leurs stratégies de données, il est également probable qu’elle joue un rôle dans le maintien de la confidentialité des données et de la conformité. Nous observons déjà de nombreux outils de cybersécurité utilisant l’IA pour analyser et trier les menaces évolutives à la sécurité des données. L’IA pourrait également simplifier l’obtention du consentement des clients en analysant les interactions des utilisateurs et en proposant des choix basés sur leurs préférences.

Ajustement des parcours clients en temps réel

L’essor des expériences client entièrement numériques a conduit à l’émergence de l’orchestration des parcours comme discipline – avec des équipes spécialisées dans les grandes organisations dédiées à la construction et à l’ajustement du parcours client pour que la marque reste aussi engageante et facile à interagir que possible.

Encore une fois, l’IA joue un rôle inestimable en offrant des analyses prédictives, fournissant des prévisions de comportements et de préférences pour permettre aux équipes de données de personnaliser les parcours clients en temps réel. Grâce à la puissance de traitement de l’IA, les campagnes marketing peuvent être analysées et ajustées en continu, garantissant que les expériences client sont aussi pertinentes et engageantes que possible.

Enfin, ces expériences engageantes ne reposent plus sur des données démographiques traditionnelles grâce à l’IA. Les listes d’audience statiques et les catégories larges appartiennent désormais au passé dans un monde où l’IA permet aux entreprises de segmenter dynamiquement les audiences en fonction de leurs comportements évolutifs. L’IA peut aider les entreprises à élaborer des campagnes plus réactives, ciblées et efficaces à mesure que de nouvelles données d’interaction et d’achat arrivent.